本地跑 AI 模型这件事,这两年变得越来越简单。早年你需要懂 CUDA、懂 Docker、懂各种环境变量,现在一个 Ollama 全搞定。但ollama run 跑的都是单模型对话,没有 Agent 能力——没有工具调用、没有多步骤推理、没有记忆系统。

现在不一样了。

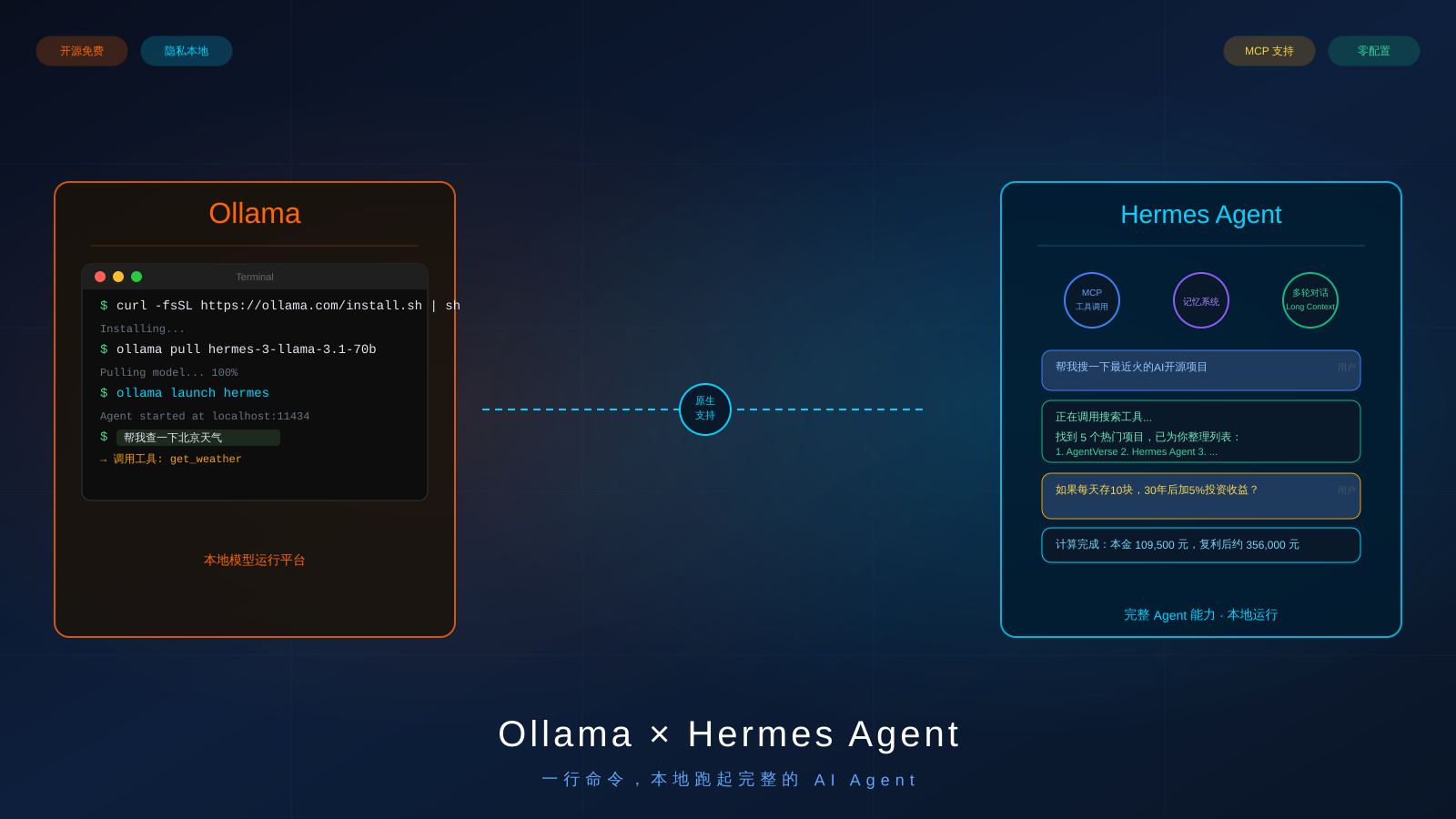

Ollama 刚刚宣布原生支持 Hermes Agent,一行命令就能在本地跑起一个完整的 AI Agent。

这意味着什么

先说结论:这是一次门槛的进一步下探。

Hermes Agent(NousResearch 出品的开源 AI Agent)是目前开源社区里最成熟的 Agent 框架之一。它支持 MCP(Model Context Protocol)、工具调用、长记忆、多轮对话,还能接入 Telegram、微信、Discord 等各种消息平台。配合各种 Skills 使用,理论上可以在本地实现一个完全私有化的 AI 助手。

但在此之前,跑 Hermes Agent 需要自己搭环境:装 Python 依赖、配 Key、写配置文件、调试各种兼容性问题。对于非开发者来说,这个门槛不低。

现在,Ollama 把这个流程压缩成了一行命令。

怎么跑(超详细,小白照着做就行)

第一步:打开终端

在开始敲命令之前,先把你的"终端"打开。这是电脑里一个用来输入命令的工具,有点像微信对话框,但输入的是指令。

macOS 用户:按键盘上的 Command 键(⌘)+ 空格键,然后搜索"终端",回车打开。

Windows 用户:按 Win 键 + R,输入 powershell,回车。或者按 Win 键 + X,选"终端"或"Windows PowerShell"。

Linux 用户:按 Ctrl + Alt + T,或者在应用菜单里搜索"终端"。

打开之后,你会看到一个黑色的窗口,里面有一行字是你的用户名和电脑名,后面跟着一个闪烁的光标——这就对了。

第二步:安装 Ollama

在终端里粘贴下面这行命令,回车:

curl -fsSL https://ollama.com/install.sh | sh等待安装完成。macOS 用户也可以直接去 https://ollama.com 下载安装包,双击运行。

Windows 用户(重点说一下):

Ollama 官方目前没有原生 Windows 桌面版,需要通过 WSL2(Windows Subsystem for Linux)来跑——相当于在 Windows 里虚拟一个 Linux 环境。步骤如下:

① 启用 WSL2

按 Win 键 + S,搜索「PowerShell」,右键「以管理员身份运行」,输入:

wsl --install回车等待下载完成。电脑可能会要求重启,重启后 WSL2 就装好了。

② 打开 Ubuntu 终端

重启完成后会自动弹出 Ubuntu 终端窗口,提示你设置用户名和密码。按提示输入即可(输入密码时屏幕不显示字符,正常现象,输入完回车再确认一次即可)。

③ 在 Ubuntu 里安装 Ollama

在 Ubuntu 终端里粘贴下面这行命令,回车:

curl -fsSL https://ollama.com/install.sh | sh安装完成后会自动注册为系统服务,以后每次开机就能直接用。

④ 验证安装

ollama version看到版本号就说明装好了,接下来继续第三步拉模型即可。

注意:WSL2 环境下 Ollama 会调用 Windows 的 GPU,如果有 NVIDIA 独显需要先装好对应驱动;如果显卡不被支持,则用 CPU 跑,速度会慢一些。

第三步:拉取 AI 模型

Ollama 本身只是一个运行模型的平台,你需要告诉它具体跑哪个模型。推荐新手从 Qwen2.5-7B 开始,电脑配置好一点的可以用 Llama3.1-8B,配置非常好的可以试 Hermes-3-70B。

在终端输入:

ollama pull qwen2.5:7b然后回车,等待下载完成(首次下载需要一点时间,取决于你的网速)。

如果你想直接跑 Hermes 官方模型,输入:

ollama pull hermes-3-llama-3.1-70b但这个模型很大(70B 参数),普通电脑跑不动,新手建议先用 qwen2.5:7b 体验。

第四步:启动 Hermes Agent

这是最关键的一步。模型拉取完成之后,在终端输入:

ollama launch hermes回车。

如果一切正常,你会看到类似"Agent started at localhost:11434"这样的提示,说明本地 Agent 服务已经跑起来了,默认监听本地的 11434 端口。

打开浏览器,访问 http://localhost:11434,就能看到 Agent 的界面了。

整个过程,不需要写代码,不需要配环境变量,不需要懂什么是 MCP。照着做就能跑起来。

本地跑 AI Agent 的实际体验

我实际在本地跑了一下。

在 MacBook Pro M3 Max(128GB 内存)上,Qwen2.5-7B 跑起来非常流畅,响应速度基本和 API 调用无异。更大的模型,比如 70B 的 Hermes-3,MacBook Pro 勉强能跑,但速度会比较慢——这是硬件限制,不是 Ollama 的问题。

Ollama 底层跑的是纯 CPU 推理(Apple Silicon 除外),配合 GPU 加速。如果你用的是 NVIDIA 显卡,Ollama 会自动调用 CUDA,效率会高很多。

对于普通用户来说,Qwen2.5-7B 或 Llama3.1-8B 是比较合理的起点——速度可以接受,功能也够用。

工具调用实测

Hermes Agent 的核心能力是工具调用。我测试了几个场景:

场景一:查天气

用户:帮我查一下北京今天天气

Agent 自动调用了天气工具,返回了温度、湿度、风力等信息。整个过程不需要我告诉它该用什么工具,它自己判断。

场景二:搜索信息

用户:帮我搜一下最近有什么 AI 开源项目比较火

Agent 调用了搜索工具,返回了几个热门的开源 AI 项目,并做了简要总结。

场景三:多步骤推理

用户:如果我每天存10块钱,30年后我能存多少?加上每年5%的投资收益呢?

Agent 分步骤计算了本金(10 × 365 × 30 = 109,500元)和复利收益,给出了最终数字。这种多步骤推理在没有 Agent 的普通聊天里很容易出错,Hermes Agent 表现稳定。

怎么知道本地能跑什么模型

这是另一个很实际的问题:我的电脑能跑多大的模型?

方法一:llmfit

llmfit 是一个专门用来检测本地硬件能力的工具。它会跑一个简短的基准测试,然后告诉你当前机器能流畅运行多大的模型。安装方式:

pip install llmfit

llmfit

跑完之后会出一个推荐列表,比如"Qwen2.5-7B 流畅"、"Llama3.1-13B 勉强"、"70B 模型不建议"。

方法二:在线检测 canirun.ai

不想装软件?直接用在线工具。canirun.ai(https://www.canirun.ai)是一个基于浏览器的硬件检测工具,打开网页它会自动跑一个 WebGPU 基准测试,几秒钟后给出你能跑什么模型的建议。

优势是方便,不需要装任何东西;劣势是 WebGPU 的测试结果和实际 Ollama 跑起来的表现会有差距,仅供参考。

Ollama + Hermes Agent 的天花板在哪里

说完了好的,也要说局限。

本地跑的模型再强,能力上限就是模型本身。开源模型(Qwen、LLaMA、Hermes)在复杂推理、长上下文理解、工具调用准确性上,和 GPT-4、Claude 3.5 这种闭源顶级模型还有差距。本地部署的优势是隐私和成本,而不是能力。

另外,Ollama 的工具调用支持目前还在快速迭代中,有些复杂的 Agent 场景(比如多 Agent 协作)目前还不太稳定。

但对于以下场景,本地部署已经非常成熟:

- 个人知识库问答

- 本地文档处理和总结

- 日常对话和写作助手

- 简单的工具调用任务

- 学习 AI Agent 的工作原理

怎么选:本地还是 API

很多人在这个问题上纠结。说一个简单粗暴的判断标准:

如果你在乎隐私、在平成本、想学习 Agent 原理——本地跑。

如果你在乎能力上限、在乎稳定性、在乎最新模型——用 API。

两者不冲突。很多人是本地做实验,API 做生产。本地跑通了,prompt 调好了,再切到 API 上去跑,体验是一样的。

总结

Ollama 原生支持 Hermes Agent 这件事,本质上是把 AI Agent 的门槛降到了历史最低点。不需要懂技术,不需要配置环境,一行命令,本地跑起来。

工具调用、多步骤推理、记忆系统,这些原本只有付费 API 才能体验的能力,现在在你的电脑上就能跑。

对于想学 AI Agent、想本地部署个人助手、想让 AI 工具完全私有的朋友,这是一个非常好的起点。

相关资源

- Ollama 官网:https://ollama.com

- Hermes Agent GitHub:https://github.com/NousResearch/hermes-agent

- 本地模型检测 canirun.ai:https://www.canirun.ai

- llmfit 工具:pip install llmfit